塵肺病在我國每年報告的新發職業病中居首位,影像學診斷目前仍是其主要的臨床診斷方法之一。然而,人工閱片對醫生水平要求較高,塵肺影像學分期診斷的判別難度大,而且由于醫療資源分布不均衡等因素的影響,很容易導致基層醫療機構出現誤診和漏診。計算機輔助診斷系統可以實現塵肺病的快速篩查,以便輔助臨床醫生進行鑒別和診斷,提高診斷效能。作為深度學習的重要分支,卷積神經網絡因具有局部關聯、權值共享的特點,擅長處理圖像分割、圖像分類、目標檢測等各種視覺任務,近年來已在塵肺病計算機輔助診斷領域得到廣泛應用。本文就卷積神經網絡(VGG、U-Net、ResNet、DenseNet、CheXNet、Inception-V3和ShuffleNet)在塵肺病影像學篩查診斷、分期診斷和病灶分割等方面的應用進行文獻回顧,旨在總結卷積神經網絡的方法、優缺點及優化策略,為塵肺病影像學計算機輔助診斷的進一步研究提供參考。

引用本文: 王瑜, 吳江, 伍東升. 卷積神經網絡在職業性塵肺病影像學診斷中的應用研究進展. 生物醫學工程學雜志, 2024, 41(2): 413-420. doi: 10.7507/1001-5515.202309079 復制

版權信息: ?四川大學華西醫院華西期刊社《生物醫學工程學雜志》版權所有,未經授權不得轉載、改編

0 引言

塵肺病是由于職業活動中長期吸入生產礦物粉塵并且在肺內潴留而引起的以肺組織彌漫性纖維化為主的疾病[1]。根據國家衛生健康委員會[2]發布的《2021年我國衛生健康事業發展統計公報》,在2021年全國共報告各類職業病新病例15 407例,其中職業性塵肺病11 809例,占比約76.6%。截至2021年底,全國累計報告職業性塵肺病患者91.5萬人,現存活的職業性塵肺病患者約45萬人,確診人數是我國職業病第一,考慮到多塵工作場所的工人接受職業健康檢查的比例較低,加上塵肺病具有潛伏期長、隱匿性強等特點,實際罹患塵肺病的人數可能遠超報告數[3]。塵肺病還會引發肺炎、肺結核、肺源性心臟衰竭等疾病,目前無法根治,治療手段以早發現、延緩病情進展和避免并發癥為主。

臨床評價塵肺病主要是依據肺部X線影像的改變。1986年以后我國職業性塵肺病的影像診斷標準中均引入了國際勞工組織提出的小陰影、大陰影等概念[4],這些術語是X線影像的形態描述,為塵肺病分期提供統一、方便和規范的紀錄,主要包括小陰影、小陰影聚集、大陰影、肺區和胸膜斑等。根據小陰影總體密集度、大陰影的肺區分布情況以及是否有胸膜斑等情況可以將塵肺病分為零期、壹期、貳期和叁期。然而由于塵肺病零期和壹期判別難度大且標準片與實際病例常存在偏差,人工閱片對醫生水平要求較高[5],加上疲勞看片等因素的影響,很容易出現誤診漏診的情況。目前我國醫療資源地域分布不均勻,高水平的醫生和高質量的醫療設備大都集中在一二線城市和三甲醫院,縣城村鎮診療系統與之相比仍有很大差距。

成熟而有效的計算機輔助系統具有快速、廉價的特點,可以實現定期健康檢查和低成本有效診斷。塵肺病影像學人工智能算法可以幫助醫生對肺部影像進行初步診斷和篩選,減少假陽性,提高診斷效率,而且為后續醫生進行病情分析提供輔助作用。因此,隨著基于人工智能的計算機輔助診斷日趨成熟,包括卷積神經網絡(convolutional neural network,CNN)在內的深度學習算法有望大幅度提高塵肺病影像學分期診斷的分析速度和檢測準確性,具有重要的臨床研究價值。

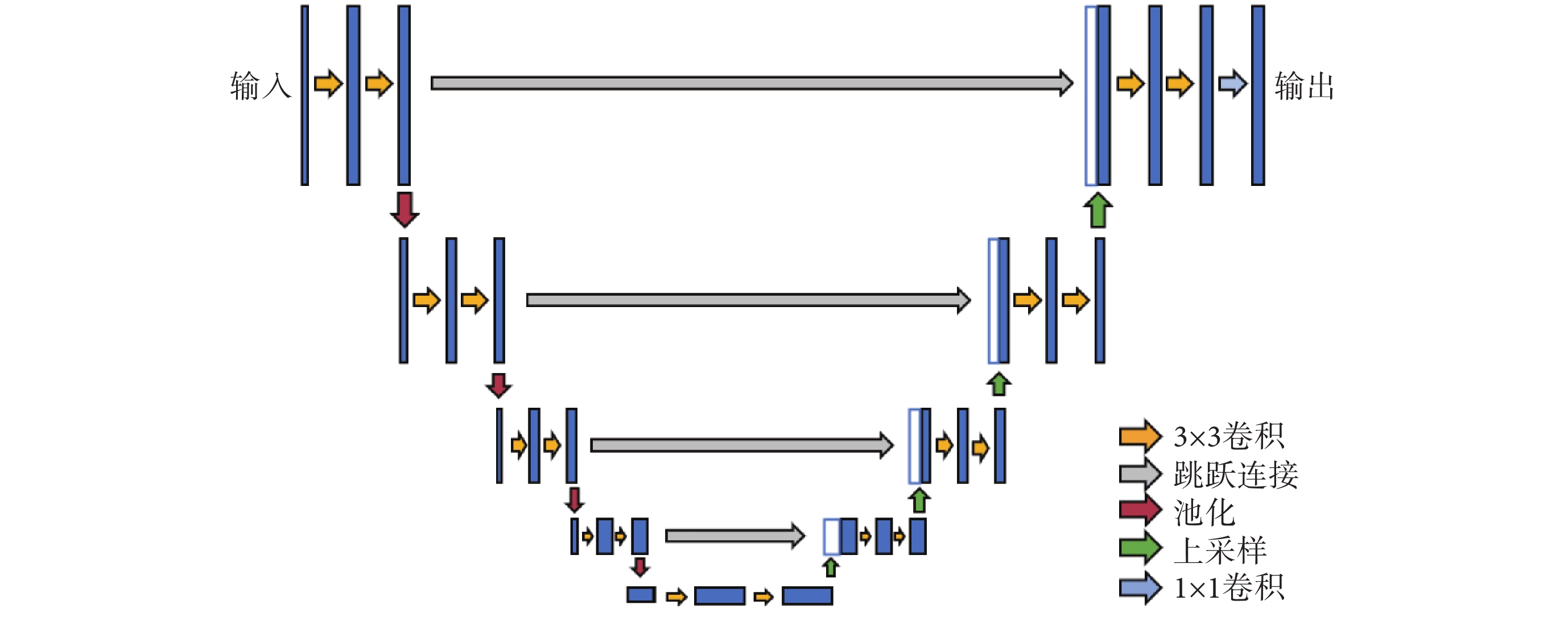

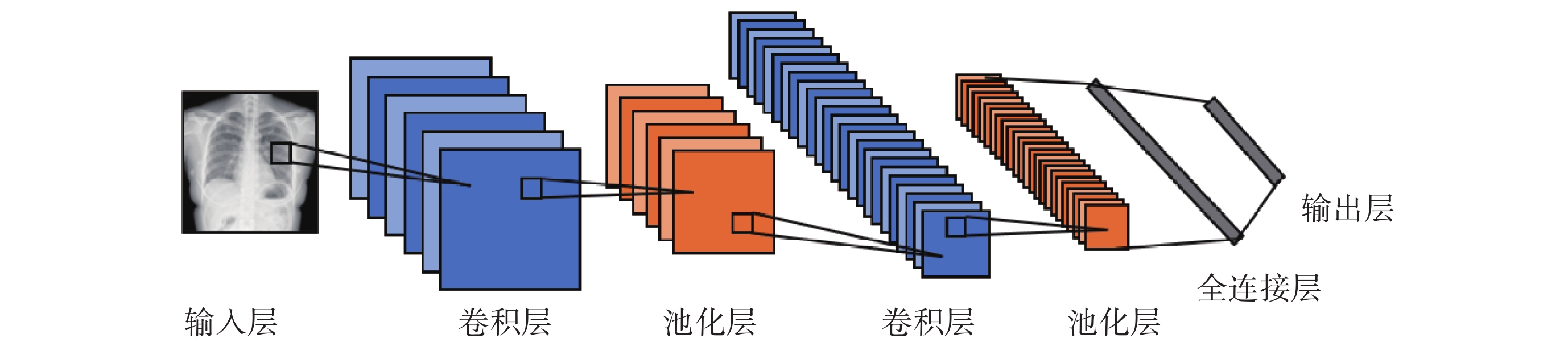

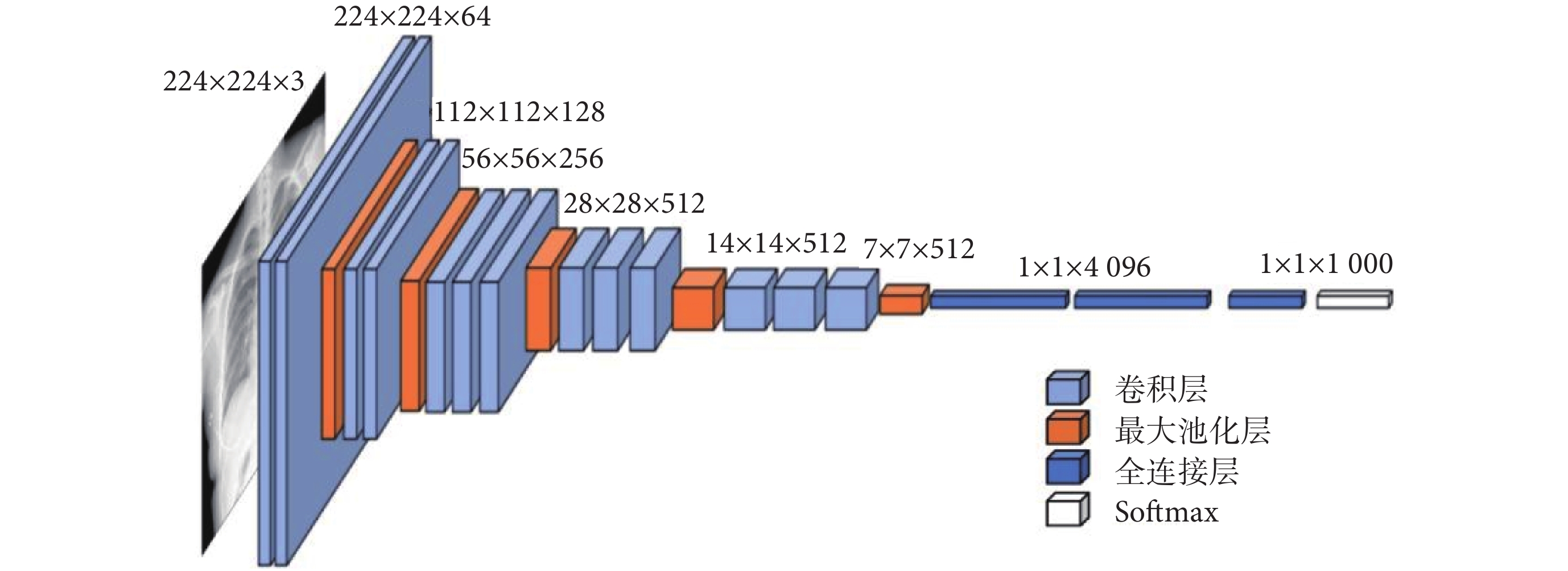

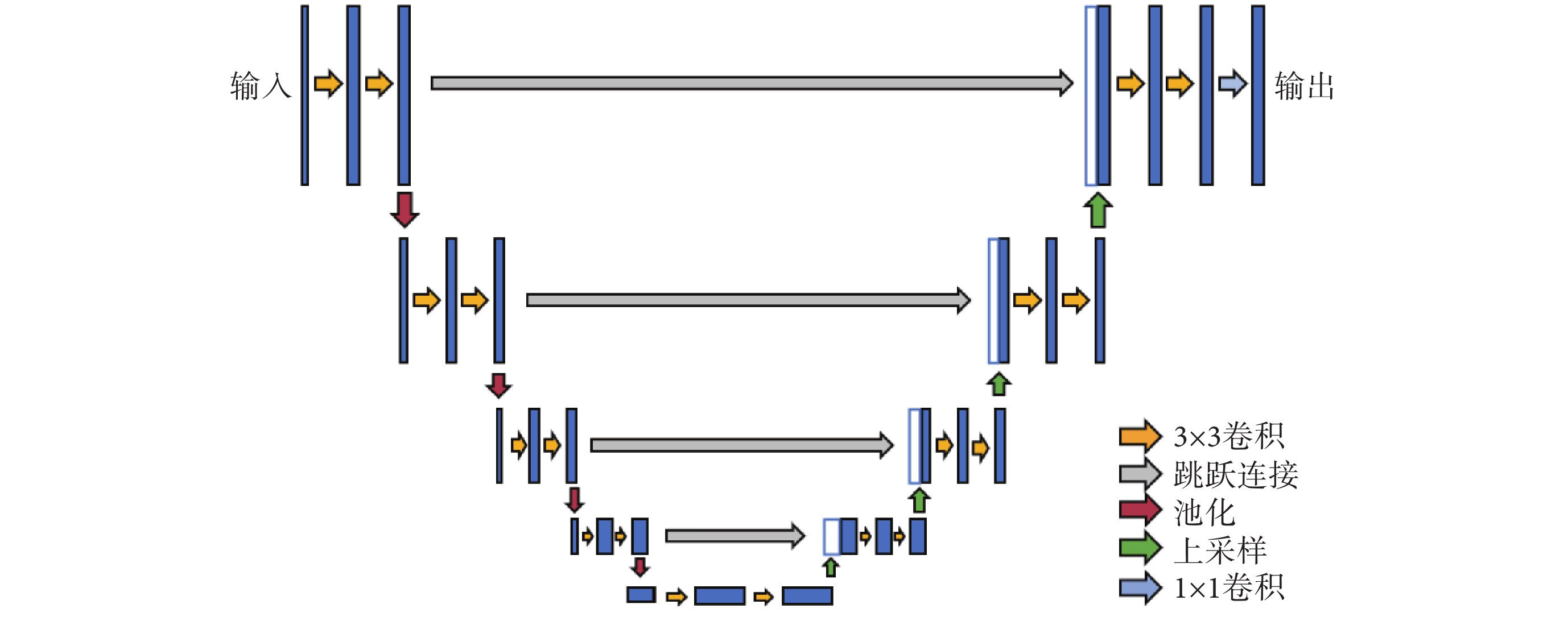

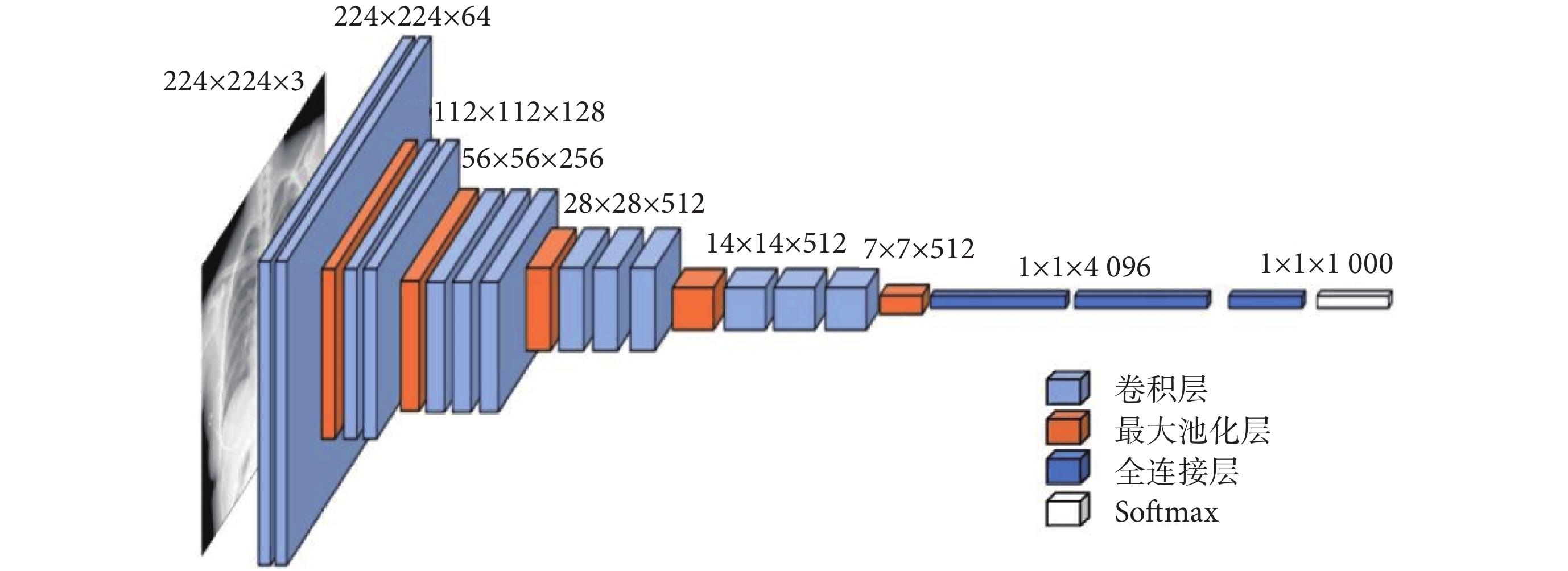

CNN是深度學習的代表算法之一,主要由輸入層、卷積層、池化層、全連接層和輸出層組成,如圖1所示。CNN提供了一個端到端的學習模型,模型中的參數采用傳統的梯度下降法進行學習,每一層的特征都是通過從上一層局部區域得到的共享權重卷積核的激勵[6-7],這使得CNN比其他神經網絡更適合處理圖像分割、圖像分類、目標檢測等各種視覺任務。為此,本文就CNN[如VGG、U-Net、殘差網絡(residual network,ResNet)、DenseNet、CheXNet、Inception-V3和ShuffleNet]在塵肺病影像學篩查診斷、分期診斷和病灶分割等方面的應用進行文獻回顧,旨在總結CNN應用于塵肺病圖像的方法、優缺點及優化思路,為塵肺病計算機輔助診斷的進一步研究提供參考。

圖1

卷積神經網絡模型結構圖

Figure1.

Structure of convolutional neural network model

圖1

卷積神經網絡模型結構圖

Figure1.

Structure of convolutional neural network model

1 CNN網絡在塵肺病篩查診斷中的應用

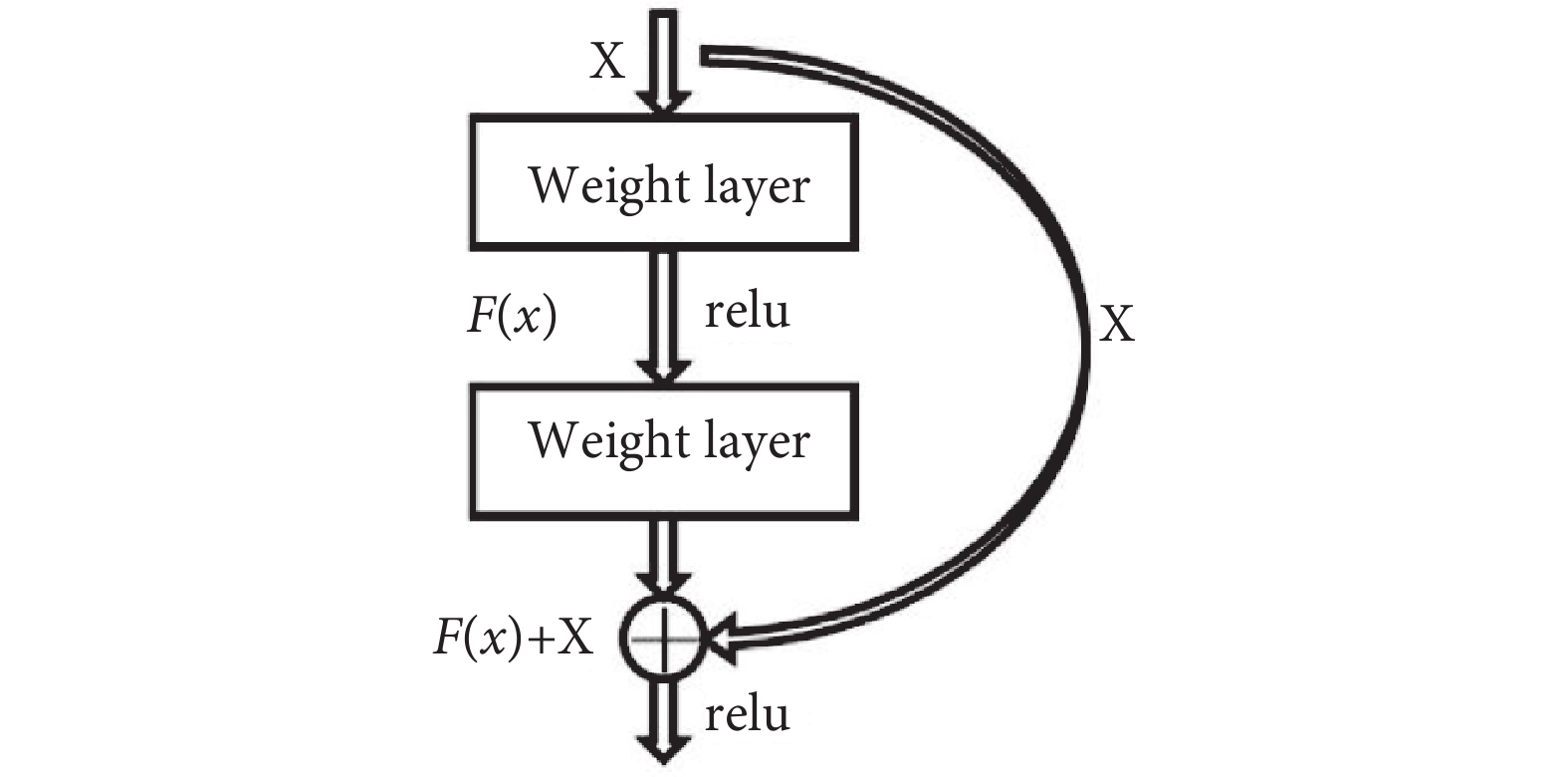

1.1 ResNet

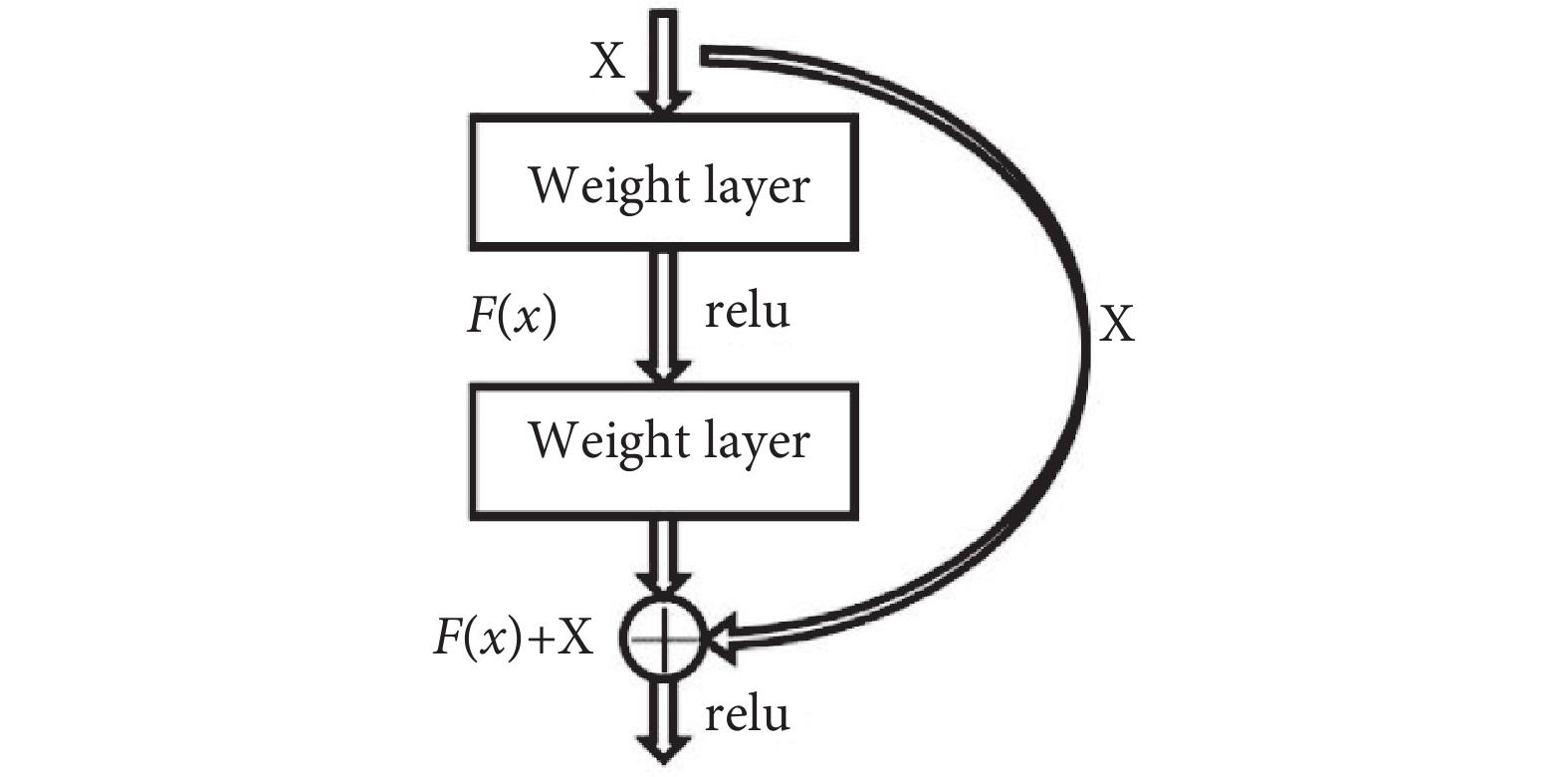

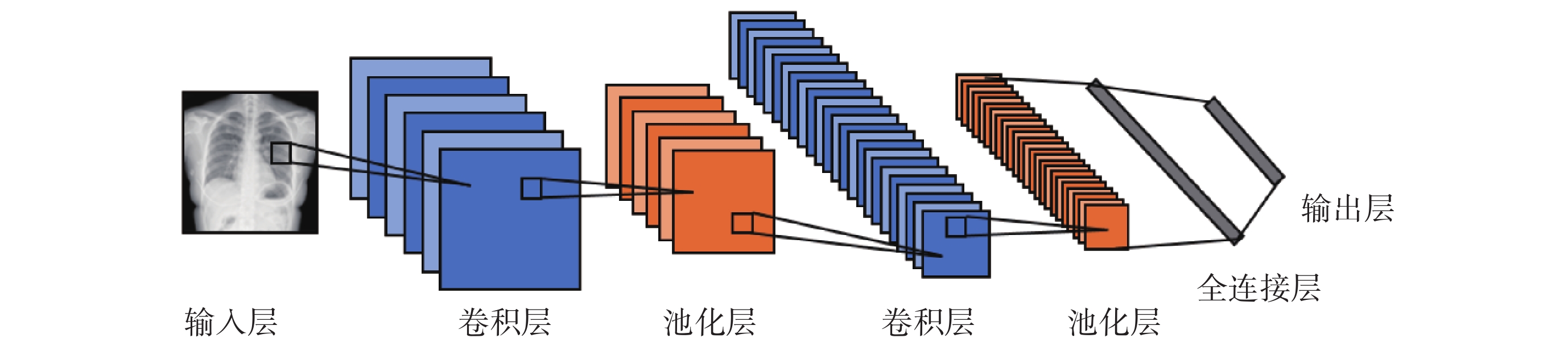

ResNet由He等[8]提出,該網絡引入了恒等映射從而通過計算殘差來緩解因網絡層數過多而產生的退化問題。殘差塊結構見圖2所示,人為使神經網絡某些層跳過下一層神經元的連接,特征矩陣隔層相加,弱化每層之間的強聯系。殘差思想本身也在一定程度上簡化了模型的學習目標,使得模型訓練更為容易[9]。但由于殘差結構特征矩陣隔層相加的特性,可能會導致網絡結構復雜,難以泛化,訓練時間長。汪偉[10]在ResNet的基礎上引入全卷積網絡的反卷積結構,對塵肺病影像學診斷靈敏度達到99%,漏診率極低,特異度為89%,準確率為95%,可以用于塵肺病的初篩,在煤工塵肺的早期篩查中能有效提高醫生的工作效率。

圖2

殘差塊結構圖

Figure2.

Structure of the residual block

圖2

殘差塊結構圖

Figure2.

Structure of the residual block

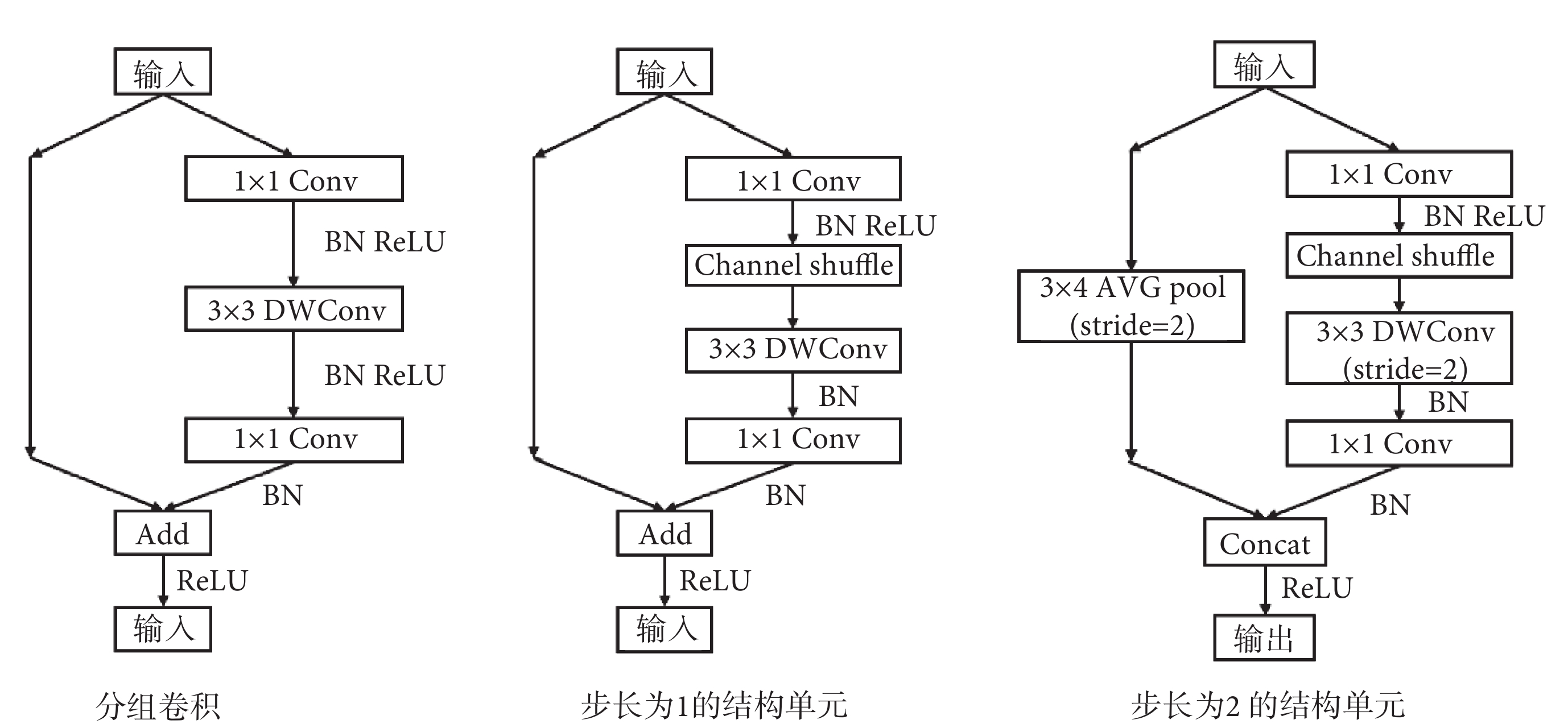

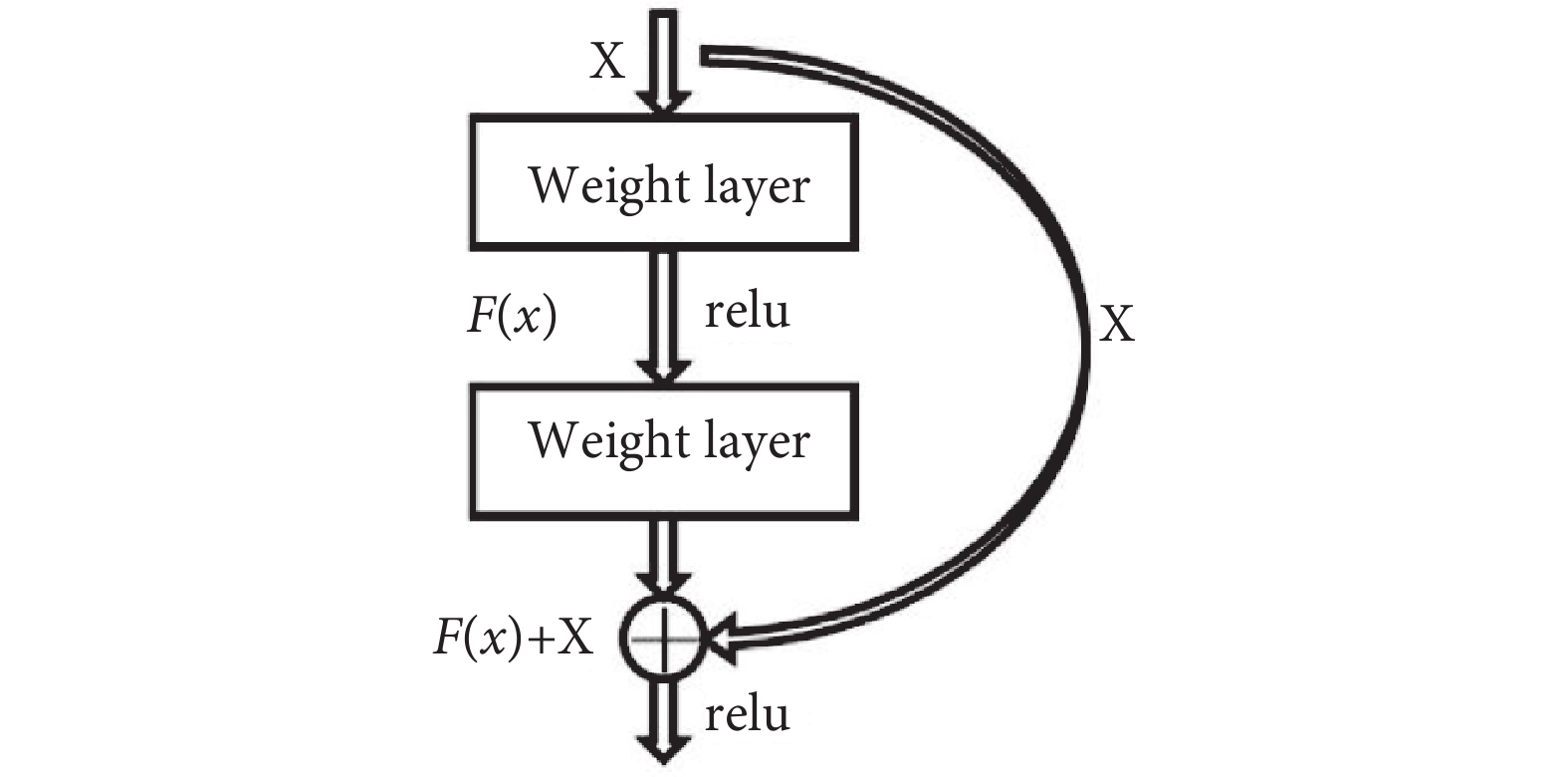

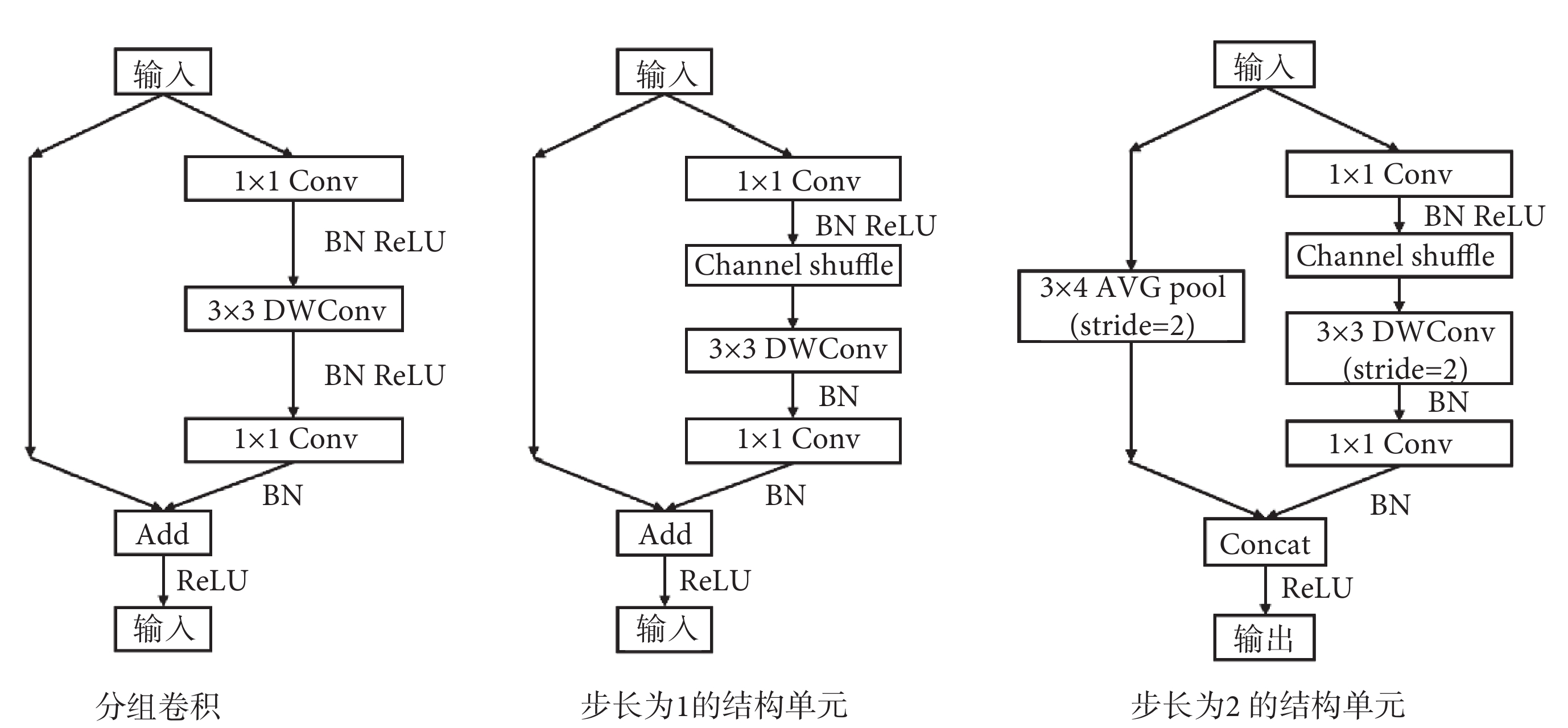

1.2 ShuffleNet

ShuffleNet是一種專門為計算能力有限的移動設備設計的高效輕量級神經網絡模型[11]。由于ResNet等CNN存在大量的1×1卷積,在小網絡模型中效率很低,因此ShuffleNet使用逐點分組卷積(pointwise group convolution)降低了1×1卷積的計算復雜度,并且為了解決由分組卷積產生的組間特征信息無共享交流問題,使用通道重排策略(Channel Shuffle),允許分組卷積從不同的組中獲取輸入數據,在保持精度的同時大大減少了計算復雜度和存儲需求[12],結構如圖3所示。然而,ShuffleNet網絡結構相對簡單,特征表達能力不足,在一些復雜任務上的表現不如其他模型 。

圖3

ShuffleNet單元結構圖

Figure3.

ShuffleNet unit structure diagram

圖3

ShuffleNet單元結構圖

Figure3.

ShuffleNet unit structure diagram

崔風濤等[13]將ShuffleNet應用于四個不同預處理的X射線數據集:16位灰度直方圖均衡圖像集(HE16)、16位灰度原始圖像集(Origin16)、8位灰度直方圖均衡圖像集(HE8)和8位灰度原始圖像集(Origin8)。其中Origin16模型結果最好,曲線下面積(area under curve,AUC)為0.958,準確率為92.3%,特異度為92.9%,敏感度為91.7%,與醫生診斷結果的一致性最高。證明了ShuffleNet模型可以有效識別早期階段的塵肺。

Wang等[14]首先采用YOLO v2分割數字化X線(digital radiography,DR)胸片,然后訓練6個CNN模型(Inception-V3、ShuffleNet、Xception、DenseNet、Resnet 101、MobileNet)識別塵肺病0/1亞類。最后通過集成學習對六個CNN模型的輸出進行集成。這種級聯策略能有效地消除原DR胸片的噪聲,解決過擬合問題。測試結果AUC、準確度、靈敏度和特異性分別為0.931、84.7%、75.0%和95.7%,表明此方法能有效篩選臨床前階段的塵肺病,有助于塵肺病的二次預防。

2 CNN網絡在塵肺病分期診斷中的應用

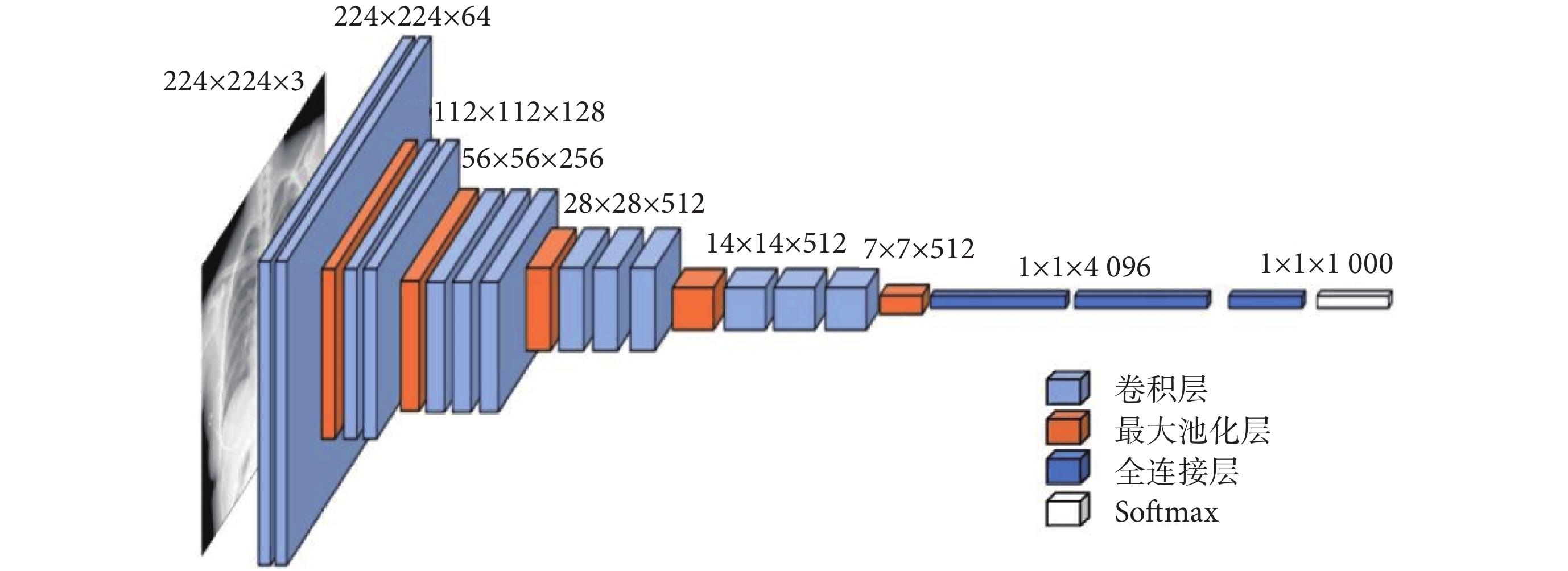

2.1 VGG16和VGG19

VGG16模型由牛津大學Visual Geometry Group小組在2014年ImageNet大賽上提出[15],一共有16個參數訓練層,分別為13個卷積層和3個全連接層,與AlexNet相比,它使用連續的2個和3個3 × 3卷積核分別代替AlexNet中5 × 5的卷積核和7 × 7的卷積核,模型如圖4所示。這保證了在具有相同感知野的條件下,網絡結構精簡且深度提高。但由于包含的權重數目多達139 357 544個,需要較大的存儲容量,不利于模型部署,還導致訓練時間過長,調參難度大。而VGG19比VGG16多出3個卷積核大小為3 × 3的卷積層,分別在第3、4、5次最大池化操作之前,堆疊的卷積操作增多,運算量增大,對圖像細節特征的提取效果更好。

圖4

VGG16模型圖

Figure4.

Structure of VGG16

圖4

VGG16模型圖

Figure4.

Structure of VGG16

趙奇等[16]采用標注數據庫對VGG16和VGG19進行訓練,VGG16的準確率為91.8%、靈敏度為69.2%,VGG19的準確率為91.8%、靈敏度為61.5%,可以看出VGG16與VGG19模型差距不大,但VGG19比VGG16層數深、參數量大,所以參數更新比較慢。針對VGG16訓練時間長的問題,舒甜督等[17]把VGG16所有的全連接層換成具有256個神經元的全連接層并連接二分類的softmax分類器,在每個卷積層之后加入批量規范化層(batch normalization,BN)[18-19]。BN層可以加快模型的訓練速度和收斂速度,防止過擬合從而呈現更好的分類效果。將改進后的模型應用于肺結節計算機斷層掃描(computed tomography, CT)圖像分類,相比原來的VGG模型,準確率提高,訓練時間大幅縮短,此改進對于該模型的優化具有參考意義。

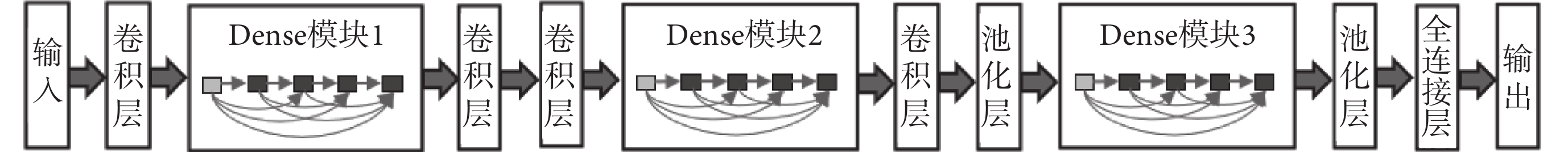

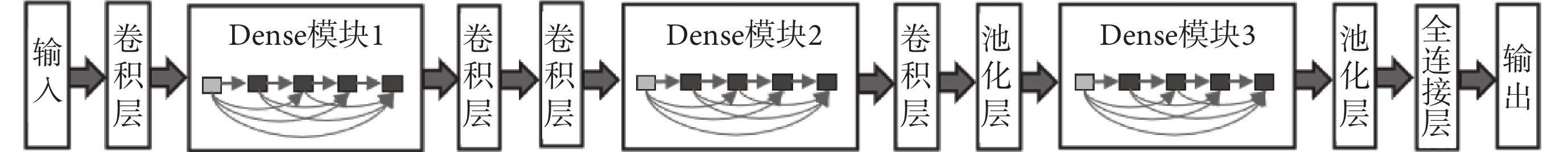

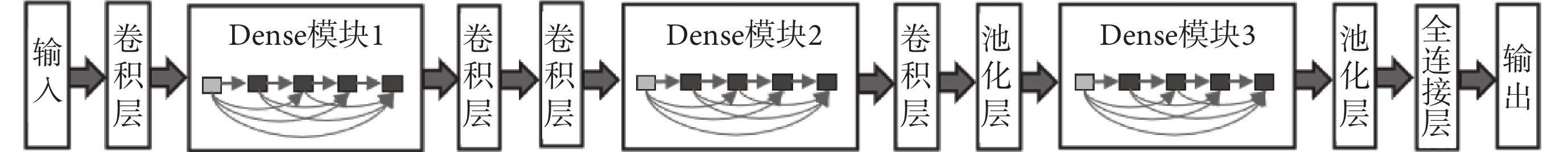

2.2 DenseNet

DenseNet模型由Huang等提出[20],在ResNet的基礎上,提出層與層的密集連接思想。在傳統CNN中,L層的網絡有L個連接,而在DenseNet中,有L(L + 1)/2個連接。每層從前面的所有層獲得額外的輸入,并將自己的特征映射傳遞到后續的所有層。使用級聯方式,每一層都在接受來自前幾層的“集體知識”。DenseNet模型如圖5所示。DenseNet通過對特征的重復使用,減少了參數量,緩解了梯度消失問題,并提高了特征的傳播率和利用率,但占用內存較大。張雅娟[21]比較了ResNet50、ResNet101、DenseNet對于塵肺四個分期的判別效能,其中DenseNet宏綜合分類率在80%以上,AUC微平均和宏平均分別為94%和95%。整體分類效能最優,為較適合的塵肺分類模型,其0期及Ⅲ期的分類效果較好,Ⅱ期的分類效果還有待優化。

圖5

DenseNet模型圖

Figure5.

Structure of DenseNet

圖5

DenseNet模型圖

Figure5.

Structure of DenseNet

Fan等[22]提出了一種局部鑒別輔助解糾纏網絡(local discriminant auxiliary disentangled network,LDADN)作為非配對醫學圖像翻譯任務的新框架,用來合成胸部X射線圖像。該模型利用幾批相互獨立的本地鑒別器來實現細節的高頻傳輸,結合局部對抗性學習和Laplacian濾波器將病變區域的特征通過單一的網絡分離出來,發生器再通過給定的屬性或隨機噪聲矢量,有效地合成具有多樣性和高質量的真實感塵肺圖像。對于塵肺病的檢測,其檢測性能優于從零開始學習的模型。研究證明,在訓練集中加入合成的塵肺圖像,可以進一步提高檢測結果,其中采用LDADN方法檢測塵肺DenseNet 121模型的準確率顯著提高,達到99.31%。

2.3 CheXNet

CheXNet模型由 Rajpurkar等[23]提出,是使用ChestX-ray14數據集訓練的121層的DenseNet。模型的全連接層替換為二進制輸出,再采用Sigmod函數實現最終分類。Devnath等[24]通過對CheXNet、DenseNet-121、Inception-V3、Xception和ResNet 50這五個模型進行研究,結果表明在小數據集上,CheXNet是最有效的塵肺分類模型,準確率達到90.20%。在此基礎上,又提出了一種基于預先訓練的CheXNet作為多級特征提取器的混合模型,解決了小數據集上塵肺檢測的難題。在所研究的模型和分類器中,CheXNet和support vector machine with sigmoid function(SVM-SF)相結合的性能最好,準確率最高可達92.68%。

集成學習是訓練多個機器學習模型并將其輸出組合在一起的過程。組織以不同的模型為基礎,致力構建一個最優的預測模型。組合各種不同的機器學習模型可以提高整體模型的穩定性,從而獲得更準確的預測結果。缺點是集成學習減少了模型的可解釋性且耗時較長。集成學習方法主要包括簡單平均法、多加權平均法和多數投票法(majority vote,MVOT)[25]。Devnath等[26]通過比較這三種方法的效果,發現MOVT與CheXNet的融合用于塵肺病檢測的效果優于其他方法,準確率可達91.50%。

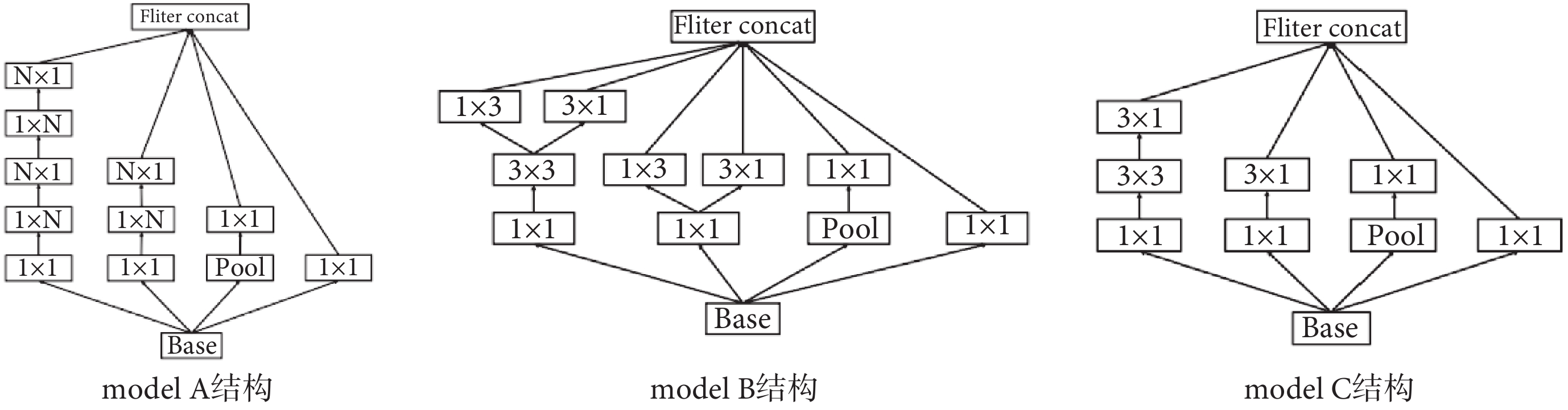

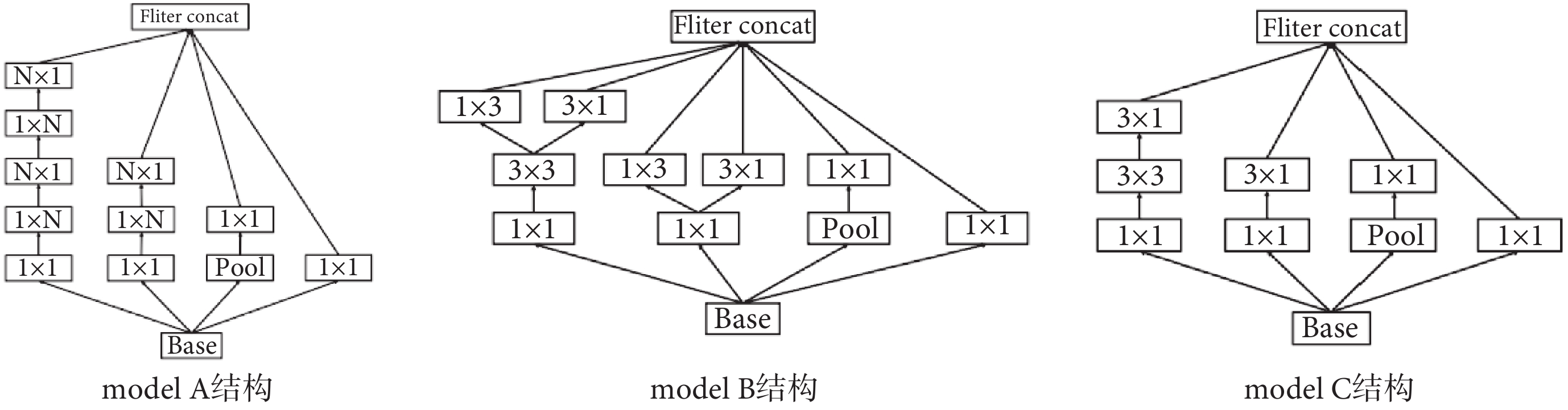

2.4 Inception-V3

Inception-V3由Christian等[27]提出,通過增加網絡的寬度來提高網絡性能。為了實現不同尺度特征的融合,在每個inception模塊中都使用了不同大小的卷積核,出現不同的感受野,并且加入卷積因子分解的思想,將大卷積核分解成小卷積,減小參數,降低模型大小,分解結構如圖6所示。但Inception架構的復雜性使得網絡更改變得更為困難。張蘭蘭[28]比較了Resnet 50、VGG 16和Inception-V3網絡的塵肺病分類效果,提出了“凍結層”和“微調層”兩種遷移學習模式[29]。“凍結層”轉移模式為將預訓練模型早期層的學習率設為0,并根據胸部X線片的類別重建后續層;“微調層”轉移模式為早期層復制預訓練模型的權重,后續層隨機初始化。ImageNet中學習到的知識被轉移到塵肺病影像的識別中,分別應用于VGG16、ResNet50和Inception-V3中。實驗結果表明,兩種遷移學習模式都比在有限的訓練數據下從頭開始要好,并且“微調層”轉移學習模式效果更好。Inception-V3 AUC值0.94,高于ResNet50網絡和VGG16,并且Inception-V3在微調層遷移模式下的靈敏度為95%,特異度為87%,平衡較好。

圖6

Inception-V3分解結構圖

Figure6.

Inception-V3 decomposition structure diagram

圖6

Inception-V3分解結構圖

Figure6.

Inception-V3 decomposition structure diagram

3 CNN網絡在塵肺病病灶分割中的應用

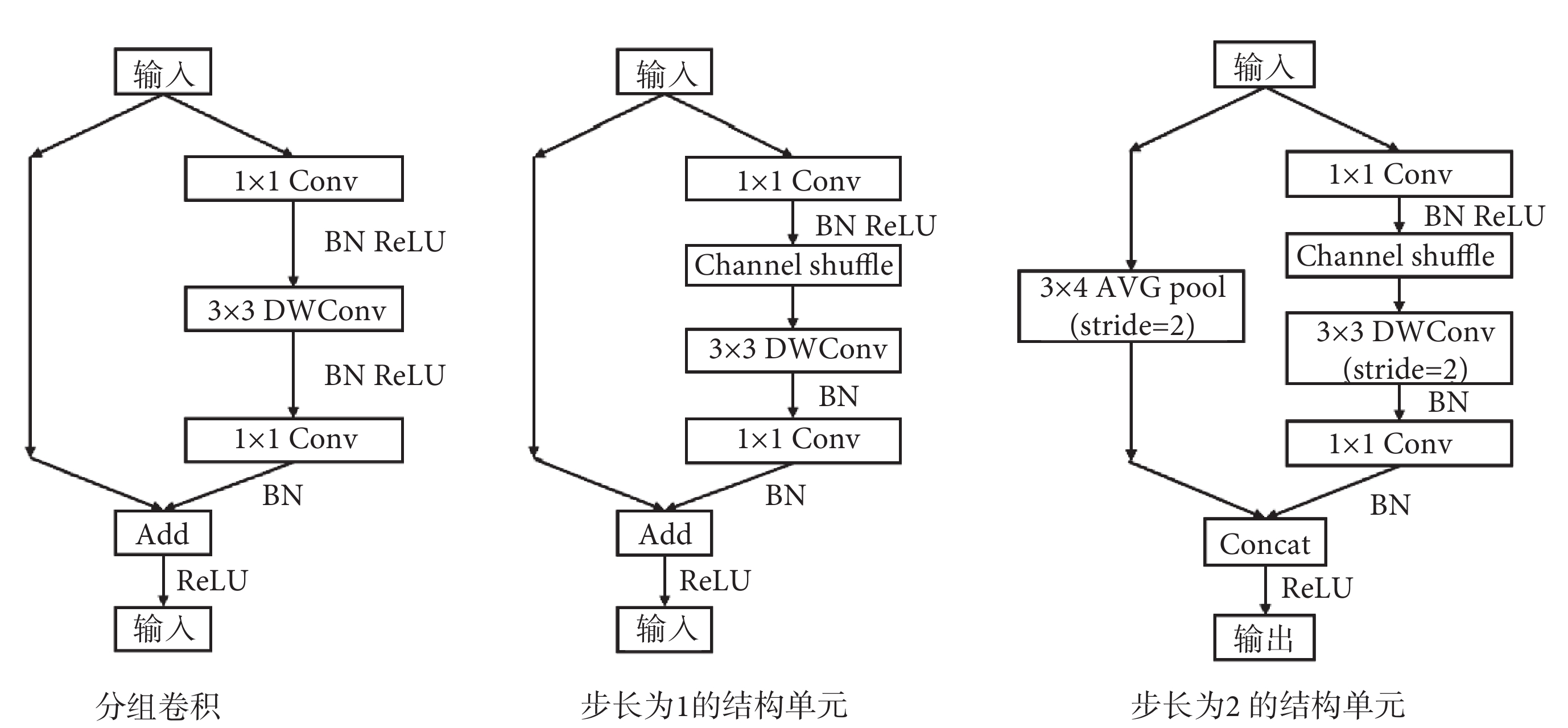

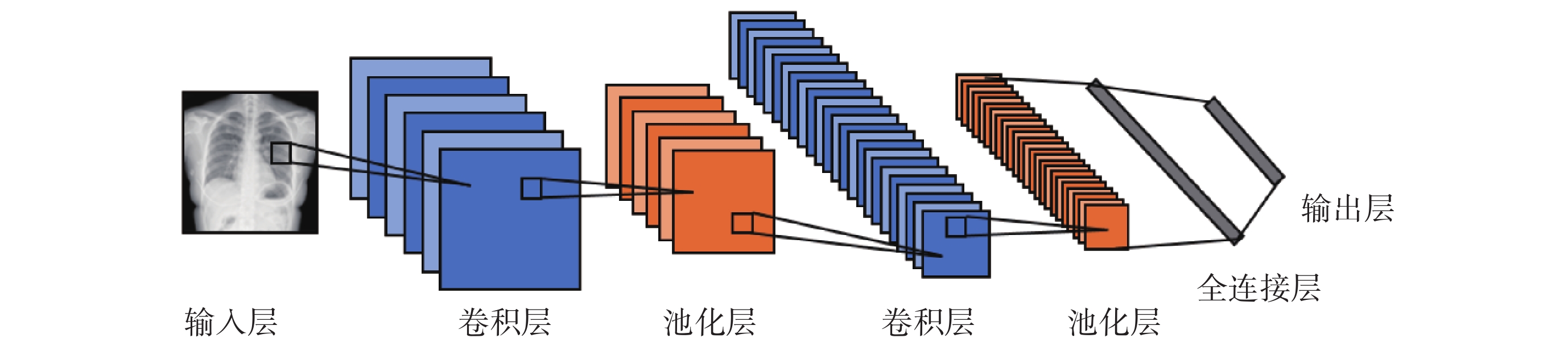

U-Net由Ronneberger等[30]提出,是建立在全卷積神經網絡(fully convolutional network,FCN)上的編碼—解碼結構的網絡模型,其結構左右對稱,呈U型。由網絡左側特征提取、中間拼接、右側上采樣三部分組成,模型圖見圖7。U-Net在醫學圖像分割領域表現出色,它的優越性與其網絡結構和醫學圖像的特點有關。醫學圖像具有固定的器官和簡單的語義,但模糊的邊界和復雜的梯度需要足夠的高分辨率信息來進行輪廓分割和細化邊緣細節。U-Net的對稱結構,通過反卷積逐步恢復圖像分辨率,并引入跳躍關節,使不同尺度的特征能夠融合在一起,為更高層次的特征帶來更高的分辨率信息,提高分割的準確性。盡管U-Net在醫學圖像分割方面取得了重大突破,但它在網絡的可擴展性和訓練小數據集時的過擬合傾向方面仍有缺陷。

基于U-Net的這種特性,常用于分割塵肺DR圖像,并與ResNet模型結合進行塵肺病分期診斷。王崢等[31]采用U-Net結構模型對胸片圖像兩側肺野進行提取,采用ResNet模型建立塵肺病計算機輔助診斷模型,AUC值為0.99,靈敏度為0.94,特異度為0.96。Yang等[32]同樣使用U-Net對胸片進行肺野分割,并使用十種不同的數據增強方法對數據集進行處理,形成十折交叉驗證,再采用ResNet用焦點損失代替原始損失函數進行塵肺分類,準確率為92.46%,AUC為0.89。Zhang等[33]提出一種基于分而治之策略的深度學習模型,即采用U-Net將一個肺部區域分割成六個子區域,使用ResNet分別訓練子區域的特定模型,并將基于子區域的預測結合起來進行分期,塵肺篩查準確率為97 .3%,敏感性和特異性均大于97%,塵肺分期的準確率為92.7%。石鳴鳴[34]使用U-Net去除胸片中的肋骨,再使用融合Inception結構的ResNet,并加入BN來加快網絡訓練的收斂和搜索速度,實現肺部影像多分類,其準確率達到80.5%,高于VGG16和ResNet101。

4 總結與展望

本文總結了VGG16和VGG19、ResNet、U-Net、DenseNet、CheXNet、Inception-V3和ShuffleNet等CNN在塵肺病影像學診斷中的應用,并分析了每個算法的優缺點,匯總內容如表1所示。

塵肺病計算機輔助診斷的發展方向應集中在以下幾個方面:

(1)由于塵肺病影像學數據的隱私性以及標注需要專業醫師,導致數據集標注數量稀缺,陽性數據和陰性數據的不平衡,大大影響了CNN的性能。一方面可以通過數據增強技術[35-36]增加訓練集的樣本量和多樣性,另一方面發展以弱監督或無監督學習為主的深度學習模型實現數據的自動標注,將極大提高模型訓練的效率[37-38]。

(2)目前開發的塵肺病計算機輔助診斷系統主要是對患者DR胸片影像特征進行識別和分類,在面對更復雜的臨床環境時,極易造成漏診或誤診。單純靠DR胸片有一定局限性,而CT能更準確地反映塵肺病的形態學改變,比X線片更容易發現肺部較小的結節[39-40],對于塵肺病早期判別有很大幫助。因此,構建融合多源影像數據的泛化模型[41],提供更加豐富的圖像信息,將有助于提高CNN辨別塵肺零期和壹期的能力。

(3)與塵肺病篩查相比,塵肺病影像學分期診斷對診斷的準確性和一致性要求更高,因為不僅要根據胸片進行判別,還要考慮患者的職業史,結合流行病學和職業監測信息,綜合臨床表現和其他常規檢查,并排除其他類似的肺部疾病。因此如何整合患者多種臨床信息,構建個人醫療數據全景圖,進一步提高計算機輔助診斷的智能化水平還需要進行更加深入的研究[42-43]。

(4)目前CNN在塵肺病方面的應用主要是對肺部影像的分類和輔助診斷,鮮有研究關注對塵肺病病程發展進行預測。根據胸片圖像特征,構建塵肺病病程預測診療模型,將有助于醫生更好地制定治療方案,有效延緩病情發展。

綜上所述,在大數據和人工智能的第4次工業革命的背景下,可預見CNN技術必將進一步推動塵肺病影像學計算機輔助診斷的發展,具有廣闊的應用前景。

重要聲明

利益沖突聲明:本文全體作者均聲明不存在利益沖突。

作者貢獻聲明:王瑜總體設計并撰寫論文、定稿;吳江參與論文思路分析與論文修改指導;伍東升參與論文修改指導和審校。

0 引言

塵肺病是由于職業活動中長期吸入生產礦物粉塵并且在肺內潴留而引起的以肺組織彌漫性纖維化為主的疾病[1]。根據國家衛生健康委員會[2]發布的《2021年我國衛生健康事業發展統計公報》,在2021年全國共報告各類職業病新病例15 407例,其中職業性塵肺病11 809例,占比約76.6%。截至2021年底,全國累計報告職業性塵肺病患者91.5萬人,現存活的職業性塵肺病患者約45萬人,確診人數是我國職業病第一,考慮到多塵工作場所的工人接受職業健康檢查的比例較低,加上塵肺病具有潛伏期長、隱匿性強等特點,實際罹患塵肺病的人數可能遠超報告數[3]。塵肺病還會引發肺炎、肺結核、肺源性心臟衰竭等疾病,目前無法根治,治療手段以早發現、延緩病情進展和避免并發癥為主。

臨床評價塵肺病主要是依據肺部X線影像的改變。1986年以后我國職業性塵肺病的影像診斷標準中均引入了國際勞工組織提出的小陰影、大陰影等概念[4],這些術語是X線影像的形態描述,為塵肺病分期提供統一、方便和規范的紀錄,主要包括小陰影、小陰影聚集、大陰影、肺區和胸膜斑等。根據小陰影總體密集度、大陰影的肺區分布情況以及是否有胸膜斑等情況可以將塵肺病分為零期、壹期、貳期和叁期。然而由于塵肺病零期和壹期判別難度大且標準片與實際病例常存在偏差,人工閱片對醫生水平要求較高[5],加上疲勞看片等因素的影響,很容易出現誤診漏診的情況。目前我國醫療資源地域分布不均勻,高水平的醫生和高質量的醫療設備大都集中在一二線城市和三甲醫院,縣城村鎮診療系統與之相比仍有很大差距。

成熟而有效的計算機輔助系統具有快速、廉價的特點,可以實現定期健康檢查和低成本有效診斷。塵肺病影像學人工智能算法可以幫助醫生對肺部影像進行初步診斷和篩選,減少假陽性,提高診斷效率,而且為后續醫生進行病情分析提供輔助作用。因此,隨著基于人工智能的計算機輔助診斷日趨成熟,包括卷積神經網絡(convolutional neural network,CNN)在內的深度學習算法有望大幅度提高塵肺病影像學分期診斷的分析速度和檢測準確性,具有重要的臨床研究價值。

CNN是深度學習的代表算法之一,主要由輸入層、卷積層、池化層、全連接層和輸出層組成,如圖1所示。CNN提供了一個端到端的學習模型,模型中的參數采用傳統的梯度下降法進行學習,每一層的特征都是通過從上一層局部區域得到的共享權重卷積核的激勵[6-7],這使得CNN比其他神經網絡更適合處理圖像分割、圖像分類、目標檢測等各種視覺任務。為此,本文就CNN[如VGG、U-Net、殘差網絡(residual network,ResNet)、DenseNet、CheXNet、Inception-V3和ShuffleNet]在塵肺病影像學篩查診斷、分期診斷和病灶分割等方面的應用進行文獻回顧,旨在總結CNN應用于塵肺病圖像的方法、優缺點及優化思路,為塵肺病計算機輔助診斷的進一步研究提供參考。

圖1

卷積神經網絡模型結構圖

Figure1.

Structure of convolutional neural network model

圖1

卷積神經網絡模型結構圖

Figure1.

Structure of convolutional neural network model

1 CNN網絡在塵肺病篩查診斷中的應用

1.1 ResNet

ResNet由He等[8]提出,該網絡引入了恒等映射從而通過計算殘差來緩解因網絡層數過多而產生的退化問題。殘差塊結構見圖2所示,人為使神經網絡某些層跳過下一層神經元的連接,特征矩陣隔層相加,弱化每層之間的強聯系。殘差思想本身也在一定程度上簡化了模型的學習目標,使得模型訓練更為容易[9]。但由于殘差結構特征矩陣隔層相加的特性,可能會導致網絡結構復雜,難以泛化,訓練時間長。汪偉[10]在ResNet的基礎上引入全卷積網絡的反卷積結構,對塵肺病影像學診斷靈敏度達到99%,漏診率極低,特異度為89%,準確率為95%,可以用于塵肺病的初篩,在煤工塵肺的早期篩查中能有效提高醫生的工作效率。

圖2

殘差塊結構圖

Figure2.

Structure of the residual block

圖2

殘差塊結構圖

Figure2.

Structure of the residual block

1.2 ShuffleNet

ShuffleNet是一種專門為計算能力有限的移動設備設計的高效輕量級神經網絡模型[11]。由于ResNet等CNN存在大量的1×1卷積,在小網絡模型中效率很低,因此ShuffleNet使用逐點分組卷積(pointwise group convolution)降低了1×1卷積的計算復雜度,并且為了解決由分組卷積產生的組間特征信息無共享交流問題,使用通道重排策略(Channel Shuffle),允許分組卷積從不同的組中獲取輸入數據,在保持精度的同時大大減少了計算復雜度和存儲需求[12],結構如圖3所示。然而,ShuffleNet網絡結構相對簡單,特征表達能力不足,在一些復雜任務上的表現不如其他模型 。

圖3

ShuffleNet單元結構圖

Figure3.

ShuffleNet unit structure diagram

圖3

ShuffleNet單元結構圖

Figure3.

ShuffleNet unit structure diagram

崔風濤等[13]將ShuffleNet應用于四個不同預處理的X射線數據集:16位灰度直方圖均衡圖像集(HE16)、16位灰度原始圖像集(Origin16)、8位灰度直方圖均衡圖像集(HE8)和8位灰度原始圖像集(Origin8)。其中Origin16模型結果最好,曲線下面積(area under curve,AUC)為0.958,準確率為92.3%,特異度為92.9%,敏感度為91.7%,與醫生診斷結果的一致性最高。證明了ShuffleNet模型可以有效識別早期階段的塵肺。

Wang等[14]首先采用YOLO v2分割數字化X線(digital radiography,DR)胸片,然后訓練6個CNN模型(Inception-V3、ShuffleNet、Xception、DenseNet、Resnet 101、MobileNet)識別塵肺病0/1亞類。最后通過集成學習對六個CNN模型的輸出進行集成。這種級聯策略能有效地消除原DR胸片的噪聲,解決過擬合問題。測試結果AUC、準確度、靈敏度和特異性分別為0.931、84.7%、75.0%和95.7%,表明此方法能有效篩選臨床前階段的塵肺病,有助于塵肺病的二次預防。

2 CNN網絡在塵肺病分期診斷中的應用

2.1 VGG16和VGG19

VGG16模型由牛津大學Visual Geometry Group小組在2014年ImageNet大賽上提出[15],一共有16個參數訓練層,分別為13個卷積層和3個全連接層,與AlexNet相比,它使用連續的2個和3個3 × 3卷積核分別代替AlexNet中5 × 5的卷積核和7 × 7的卷積核,模型如圖4所示。這保證了在具有相同感知野的條件下,網絡結構精簡且深度提高。但由于包含的權重數目多達139 357 544個,需要較大的存儲容量,不利于模型部署,還導致訓練時間過長,調參難度大。而VGG19比VGG16多出3個卷積核大小為3 × 3的卷積層,分別在第3、4、5次最大池化操作之前,堆疊的卷積操作增多,運算量增大,對圖像細節特征的提取效果更好。

圖4

VGG16模型圖

Figure4.

Structure of VGG16

圖4

VGG16模型圖

Figure4.

Structure of VGG16

趙奇等[16]采用標注數據庫對VGG16和VGG19進行訓練,VGG16的準確率為91.8%、靈敏度為69.2%,VGG19的準確率為91.8%、靈敏度為61.5%,可以看出VGG16與VGG19模型差距不大,但VGG19比VGG16層數深、參數量大,所以參數更新比較慢。針對VGG16訓練時間長的問題,舒甜督等[17]把VGG16所有的全連接層換成具有256個神經元的全連接層并連接二分類的softmax分類器,在每個卷積層之后加入批量規范化層(batch normalization,BN)[18-19]。BN層可以加快模型的訓練速度和收斂速度,防止過擬合從而呈現更好的分類效果。將改進后的模型應用于肺結節計算機斷層掃描(computed tomography, CT)圖像分類,相比原來的VGG模型,準確率提高,訓練時間大幅縮短,此改進對于該模型的優化具有參考意義。

2.2 DenseNet

DenseNet模型由Huang等提出[20],在ResNet的基礎上,提出層與層的密集連接思想。在傳統CNN中,L層的網絡有L個連接,而在DenseNet中,有L(L + 1)/2個連接。每層從前面的所有層獲得額外的輸入,并將自己的特征映射傳遞到后續的所有層。使用級聯方式,每一層都在接受來自前幾層的“集體知識”。DenseNet模型如圖5所示。DenseNet通過對特征的重復使用,減少了參數量,緩解了梯度消失問題,并提高了特征的傳播率和利用率,但占用內存較大。張雅娟[21]比較了ResNet50、ResNet101、DenseNet對于塵肺四個分期的判別效能,其中DenseNet宏綜合分類率在80%以上,AUC微平均和宏平均分別為94%和95%。整體分類效能最優,為較適合的塵肺分類模型,其0期及Ⅲ期的分類效果較好,Ⅱ期的分類效果還有待優化。

圖5

DenseNet模型圖

Figure5.

Structure of DenseNet

圖5

DenseNet模型圖

Figure5.

Structure of DenseNet

Fan等[22]提出了一種局部鑒別輔助解糾纏網絡(local discriminant auxiliary disentangled network,LDADN)作為非配對醫學圖像翻譯任務的新框架,用來合成胸部X射線圖像。該模型利用幾批相互獨立的本地鑒別器來實現細節的高頻傳輸,結合局部對抗性學習和Laplacian濾波器將病變區域的特征通過單一的網絡分離出來,發生器再通過給定的屬性或隨機噪聲矢量,有效地合成具有多樣性和高質量的真實感塵肺圖像。對于塵肺病的檢測,其檢測性能優于從零開始學習的模型。研究證明,在訓練集中加入合成的塵肺圖像,可以進一步提高檢測結果,其中采用LDADN方法檢測塵肺DenseNet 121模型的準確率顯著提高,達到99.31%。

2.3 CheXNet

CheXNet模型由 Rajpurkar等[23]提出,是使用ChestX-ray14數據集訓練的121層的DenseNet。模型的全連接層替換為二進制輸出,再采用Sigmod函數實現最終分類。Devnath等[24]通過對CheXNet、DenseNet-121、Inception-V3、Xception和ResNet 50這五個模型進行研究,結果表明在小數據集上,CheXNet是最有效的塵肺分類模型,準確率達到90.20%。在此基礎上,又提出了一種基于預先訓練的CheXNet作為多級特征提取器的混合模型,解決了小數據集上塵肺檢測的難題。在所研究的模型和分類器中,CheXNet和support vector machine with sigmoid function(SVM-SF)相結合的性能最好,準確率最高可達92.68%。

集成學習是訓練多個機器學習模型并將其輸出組合在一起的過程。組織以不同的模型為基礎,致力構建一個最優的預測模型。組合各種不同的機器學習模型可以提高整體模型的穩定性,從而獲得更準確的預測結果。缺點是集成學習減少了模型的可解釋性且耗時較長。集成學習方法主要包括簡單平均法、多加權平均法和多數投票法(majority vote,MVOT)[25]。Devnath等[26]通過比較這三種方法的效果,發現MOVT與CheXNet的融合用于塵肺病檢測的效果優于其他方法,準確率可達91.50%。

2.4 Inception-V3

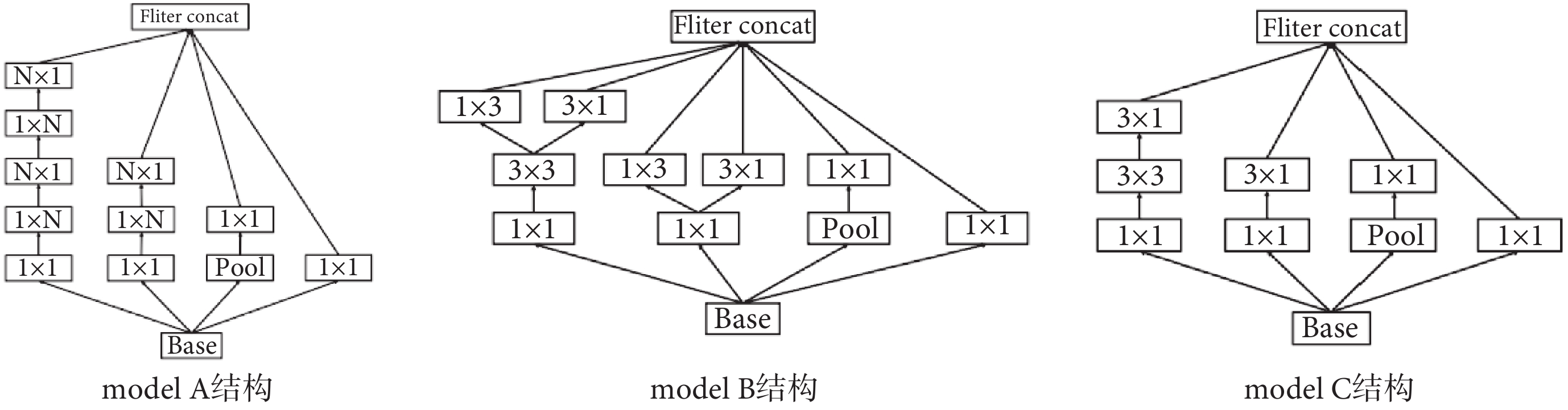

Inception-V3由Christian等[27]提出,通過增加網絡的寬度來提高網絡性能。為了實現不同尺度特征的融合,在每個inception模塊中都使用了不同大小的卷積核,出現不同的感受野,并且加入卷積因子分解的思想,將大卷積核分解成小卷積,減小參數,降低模型大小,分解結構如圖6所示。但Inception架構的復雜性使得網絡更改變得更為困難。張蘭蘭[28]比較了Resnet 50、VGG 16和Inception-V3網絡的塵肺病分類效果,提出了“凍結層”和“微調層”兩種遷移學習模式[29]。“凍結層”轉移模式為將預訓練模型早期層的學習率設為0,并根據胸部X線片的類別重建后續層;“微調層”轉移模式為早期層復制預訓練模型的權重,后續層隨機初始化。ImageNet中學習到的知識被轉移到塵肺病影像的識別中,分別應用于VGG16、ResNet50和Inception-V3中。實驗結果表明,兩種遷移學習模式都比在有限的訓練數據下從頭開始要好,并且“微調層”轉移學習模式效果更好。Inception-V3 AUC值0.94,高于ResNet50網絡和VGG16,并且Inception-V3在微調層遷移模式下的靈敏度為95%,特異度為87%,平衡較好。

圖6

Inception-V3分解結構圖

Figure6.

Inception-V3 decomposition structure diagram

圖6

Inception-V3分解結構圖

Figure6.

Inception-V3 decomposition structure diagram

3 CNN網絡在塵肺病病灶分割中的應用

U-Net由Ronneberger等[30]提出,是建立在全卷積神經網絡(fully convolutional network,FCN)上的編碼—解碼結構的網絡模型,其結構左右對稱,呈U型。由網絡左側特征提取、中間拼接、右側上采樣三部分組成,模型圖見圖7。U-Net在醫學圖像分割領域表現出色,它的優越性與其網絡結構和醫學圖像的特點有關。醫學圖像具有固定的器官和簡單的語義,但模糊的邊界和復雜的梯度需要足夠的高分辨率信息來進行輪廓分割和細化邊緣細節。U-Net的對稱結構,通過反卷積逐步恢復圖像分辨率,并引入跳躍關節,使不同尺度的特征能夠融合在一起,為更高層次的特征帶來更高的分辨率信息,提高分割的準確性。盡管U-Net在醫學圖像分割方面取得了重大突破,但它在網絡的可擴展性和訓練小數據集時的過擬合傾向方面仍有缺陷。

基于U-Net的這種特性,常用于分割塵肺DR圖像,并與ResNet模型結合進行塵肺病分期診斷。王崢等[31]采用U-Net結構模型對胸片圖像兩側肺野進行提取,采用ResNet模型建立塵肺病計算機輔助診斷模型,AUC值為0.99,靈敏度為0.94,特異度為0.96。Yang等[32]同樣使用U-Net對胸片進行肺野分割,并使用十種不同的數據增強方法對數據集進行處理,形成十折交叉驗證,再采用ResNet用焦點損失代替原始損失函數進行塵肺分類,準確率為92.46%,AUC為0.89。Zhang等[33]提出一種基于分而治之策略的深度學習模型,即采用U-Net將一個肺部區域分割成六個子區域,使用ResNet分別訓練子區域的特定模型,并將基于子區域的預測結合起來進行分期,塵肺篩查準確率為97 .3%,敏感性和特異性均大于97%,塵肺分期的準確率為92.7%。石鳴鳴[34]使用U-Net去除胸片中的肋骨,再使用融合Inception結構的ResNet,并加入BN來加快網絡訓練的收斂和搜索速度,實現肺部影像多分類,其準確率達到80.5%,高于VGG16和ResNet101。

4 總結與展望

本文總結了VGG16和VGG19、ResNet、U-Net、DenseNet、CheXNet、Inception-V3和ShuffleNet等CNN在塵肺病影像學診斷中的應用,并分析了每個算法的優缺點,匯總內容如表1所示。

塵肺病計算機輔助診斷的發展方向應集中在以下幾個方面:

(1)由于塵肺病影像學數據的隱私性以及標注需要專業醫師,導致數據集標注數量稀缺,陽性數據和陰性數據的不平衡,大大影響了CNN的性能。一方面可以通過數據增強技術[35-36]增加訓練集的樣本量和多樣性,另一方面發展以弱監督或無監督學習為主的深度學習模型實現數據的自動標注,將極大提高模型訓練的效率[37-38]。

(2)目前開發的塵肺病計算機輔助診斷系統主要是對患者DR胸片影像特征進行識別和分類,在面對更復雜的臨床環境時,極易造成漏診或誤診。單純靠DR胸片有一定局限性,而CT能更準確地反映塵肺病的形態學改變,比X線片更容易發現肺部較小的結節[39-40],對于塵肺病早期判別有很大幫助。因此,構建融合多源影像數據的泛化模型[41],提供更加豐富的圖像信息,將有助于提高CNN辨別塵肺零期和壹期的能力。

(3)與塵肺病篩查相比,塵肺病影像學分期診斷對診斷的準確性和一致性要求更高,因為不僅要根據胸片進行判別,還要考慮患者的職業史,結合流行病學和職業監測信息,綜合臨床表現和其他常規檢查,并排除其他類似的肺部疾病。因此如何整合患者多種臨床信息,構建個人醫療數據全景圖,進一步提高計算機輔助診斷的智能化水平還需要進行更加深入的研究[42-43]。

(4)目前CNN在塵肺病方面的應用主要是對肺部影像的分類和輔助診斷,鮮有研究關注對塵肺病病程發展進行預測。根據胸片圖像特征,構建塵肺病病程預測診療模型,將有助于醫生更好地制定治療方案,有效延緩病情發展。

綜上所述,在大數據和人工智能的第4次工業革命的背景下,可預見CNN技術必將進一步推動塵肺病影像學計算機輔助診斷的發展,具有廣闊的應用前景。

重要聲明

利益沖突聲明:本文全體作者均聲明不存在利益沖突。

作者貢獻聲明:王瑜總體設計并撰寫論文、定稿;吳江參與論文思路分析與論文修改指導;伍東升參與論文修改指導和審校。